Définition du RAG

Le RAG (Retrieval-Augmented Generation) est le processus par lequel une IA générative va chercher des informations dans des sources externes avant de produire sa réponse. Au lieu de se baser uniquement sur ses données d'entraînement, le modèle récupère des contenus en temps réel, les analyse, et les utilise pour construire une réponse plus précise, plus actuelle et plus fiable.

C'est ce mécanisme qui explique pourquoi ChatGPT, Perplexity ou Google AI Overviews peuvent citer des sources, afficher des liens et fournir des données à jour.

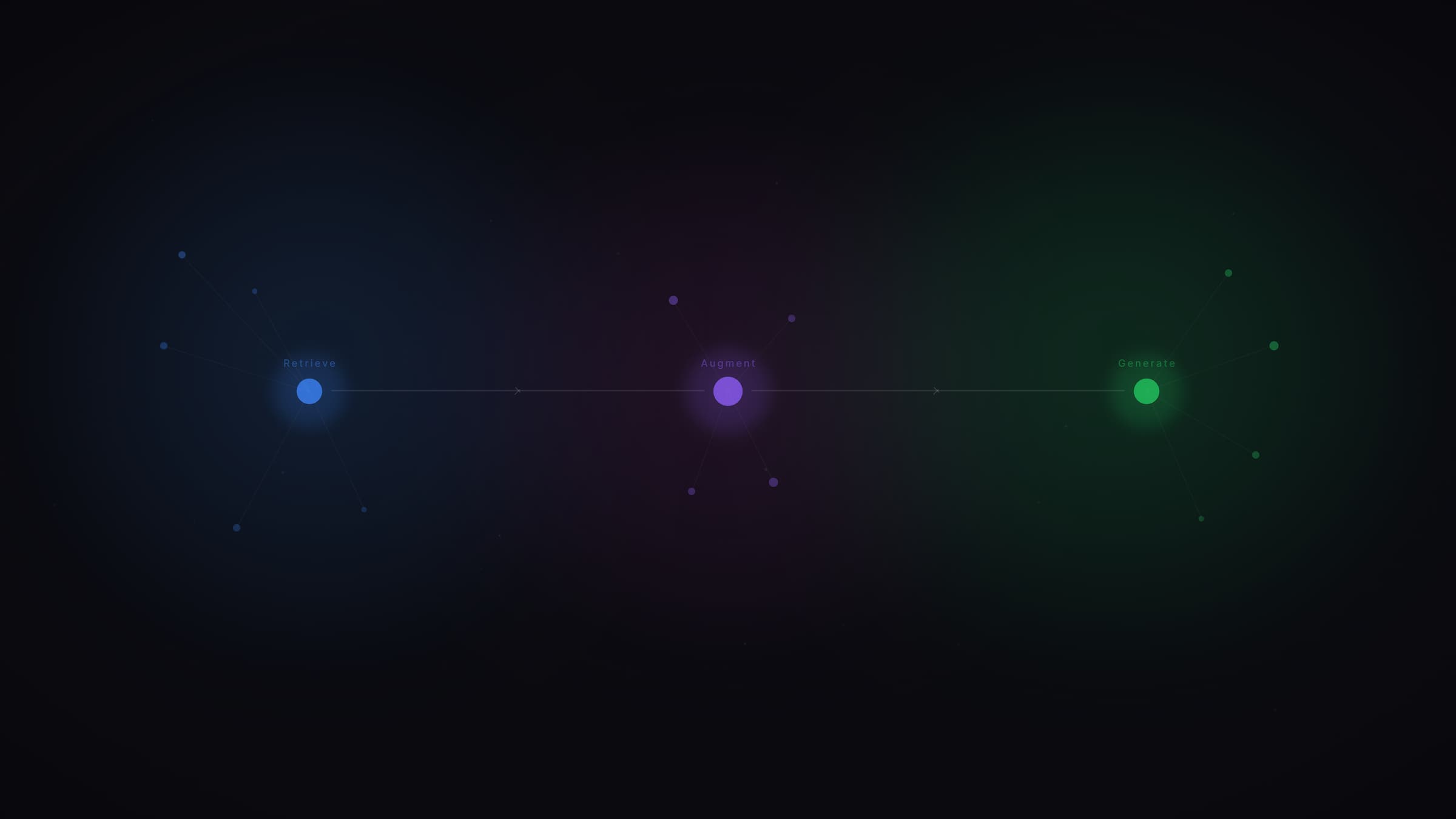

Comment fonctionne le pipeline RAG

Le RAG suit un pipeline en plusieurs étapes :

1. Réception de la requête. L'utilisateur pose une question. Le modèle évalue s'il a besoin d'informations externes ou si sa base de connaissances suffit.

2. Décomposition et recherche. La question est reformulée en sous-requêtes. Un système de recherche (index web, base vectorielle) récupère les documents les plus pertinents.

3. Sélection des passages. Parmi les documents récupérés, le modèle identifie les passages spécifiques qui répondent le mieux à la question.

4. Génération de la réponse. Le LLM synthétise les passages sélectionnés en une réponse cohérente, avec des citations vers les sources utilisées.

Pourquoi le RAG évolue en 2026

Le RAG classique (indexation + recherche + génération) reste le standard pour les systèmes nécessitant des données à jour. Mais le paysage évolue.

Avec l'extension des fenêtres de contexte (Llama 4 atteint 10 millions de tokens), certaines tâches documentaires qui nécessitaient auparavant du RAG peuvent désormais être traitées par ingestion directe. Le RAG ne disparaît pas, mais son rôle se recentre sur les cas où la fraîcheur et la vérifiabilité des données sont critiques.

Les pipelines RAG modernes intègrent également des mécanismes de vérification : le modèle croise les informations entre plusieurs sources avant de générer, réduisant les hallucinations.

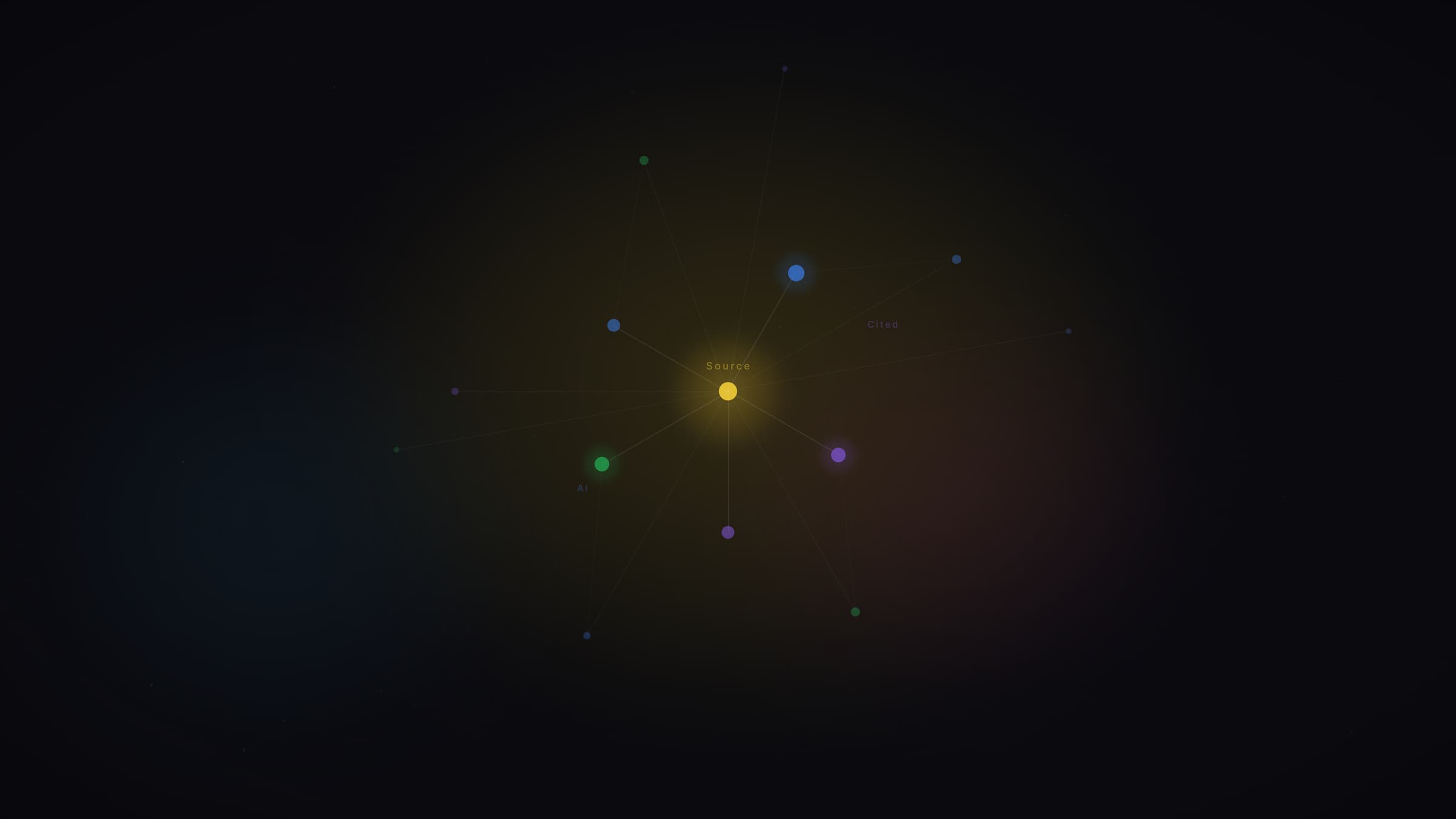

Le RAG vu depuis une stratégie GEO

Pour le GEO, le RAG est le point d'entrée de votre contenu dans les réponses IA. Si votre page n'est pas récupérée par le pipeline RAG, elle ne sera jamais citée.

Ce qu'on observe chez Vydera : les contenus qui passent le filtre RAG partagent des caractéristiques communes :

- Réponse directe dans les premiers paragraphes

- Structure claire avec des sous-titres questions

- Données factuelles précises et vérifiables

- Autorité de domaine reconnue via des signaux externes

Les contenus longs avec des introductions vagues, du jargon marketing ou une absence de sources sont systématiquement ignorés par les pipelines RAG.

Sources et références

- Aggarwal et al., GEO: Generative Engine Optimization, ACM SIGKDD 2024

- Google Search Central, AI Features and Your Website

- Sebastian Raschka, The State of LLMs 2025

Aller plus loin

Le RAG détermine si votre contenu entre dans les réponses IA ou reste invisible. Chez Vydera, on structure les contenus de nos clients pour maximiser leur taux de récupération par les pipelines RAG. Découvrez nos études de cas ou explorez le Lab Vydera.

Le RAG est-il utilisé par tous les LLMs ?

Non. Certains LLMs répondent uniquement depuis leur base de connaissances d'entraînement (mode paramétrique). D'autres activent un pipeline RAG pour des recherches en temps réel. ChatGPT Search, Perplexity et Google AI Overviews utilisent systématiquement le RAG. Claude l'active de manière sélective.

Comment optimiser son contenu pour le RAG ?

Les clés : placer la réponse dans les 200 premiers mots, structurer avec des sous-titres en forme de questions, inclure des données factuelles vérifiables, et utiliser des données structurées (JSON-LD). Le contenu doit être extractible sans reformulation par le modèle.

Le RAG va-t-il disparaître avec les grandes fenêtres de contexte ?

Pas complètement. Les fenêtres de contexte étendues réduisent le besoin de RAG pour certaines tâches documentaires. Mais pour les requêtes nécessitant des données fraîches et vérifiables, le RAG reste indispensable. Son rôle évolue, mais il ne disparaît pas.

Quelle est la différence entre RAG et fine-tuning ?

Le fine-tuning modifie les paramètres du modèle en l'entraînant sur des données spécifiques. Le RAG laisse le modèle intact et lui fournit des informations à la volée via la recherche. Le RAG est plus flexible, moins coûteux, et garde les données à jour sans réentraînement.