Points clés de l'article

- Le RAG (Retrieval-Augmented Generation) est le mécanisme qui permet aux IA de chercher des informations en temps réel avant de générer une réponse

- Sans RAG, les LLM se limitent à leurs données d'entrainement. Avec le RAG, ils vont lire vos pages en direct pour construire leurs réponses

- Votre contenu est découpé en chunks (passages), transformé en vecteurs, puis comparé à la requête utilisateur par similarité sémantique

- Ce qui détermine si votre contenu est cité, c'est la clarté de vos passages, pas la longueur de vos pages

- Comprendre le pipeline RAG est la base pour optimiser sa visibilité dans les IA : c'est le fondement technique du GEO

Le RAG (Retrieval-Augmented Generation) est le processus par lequel une IA générative va chercher des informations dans des sources externes avant de produire sa réponse. Au lieu de se baser uniquement sur ce qu'elle a appris pendant son entrainement, l'IA récupère des contenus en temps réel, les analyse, et les utilise pour construire une réponse plus précise, plus actuelle et plus fiable.

C'est ce mécanisme qui explique pourquoi ChatGPT, Perplexity ou Google AI Overviews peuvent citer des sources, afficher des liens et fournir des données à jour. Et c'est aussi ce mécanisme qui détermine quels sites sont cités dans les réponses, et lesquels sont ignorés.

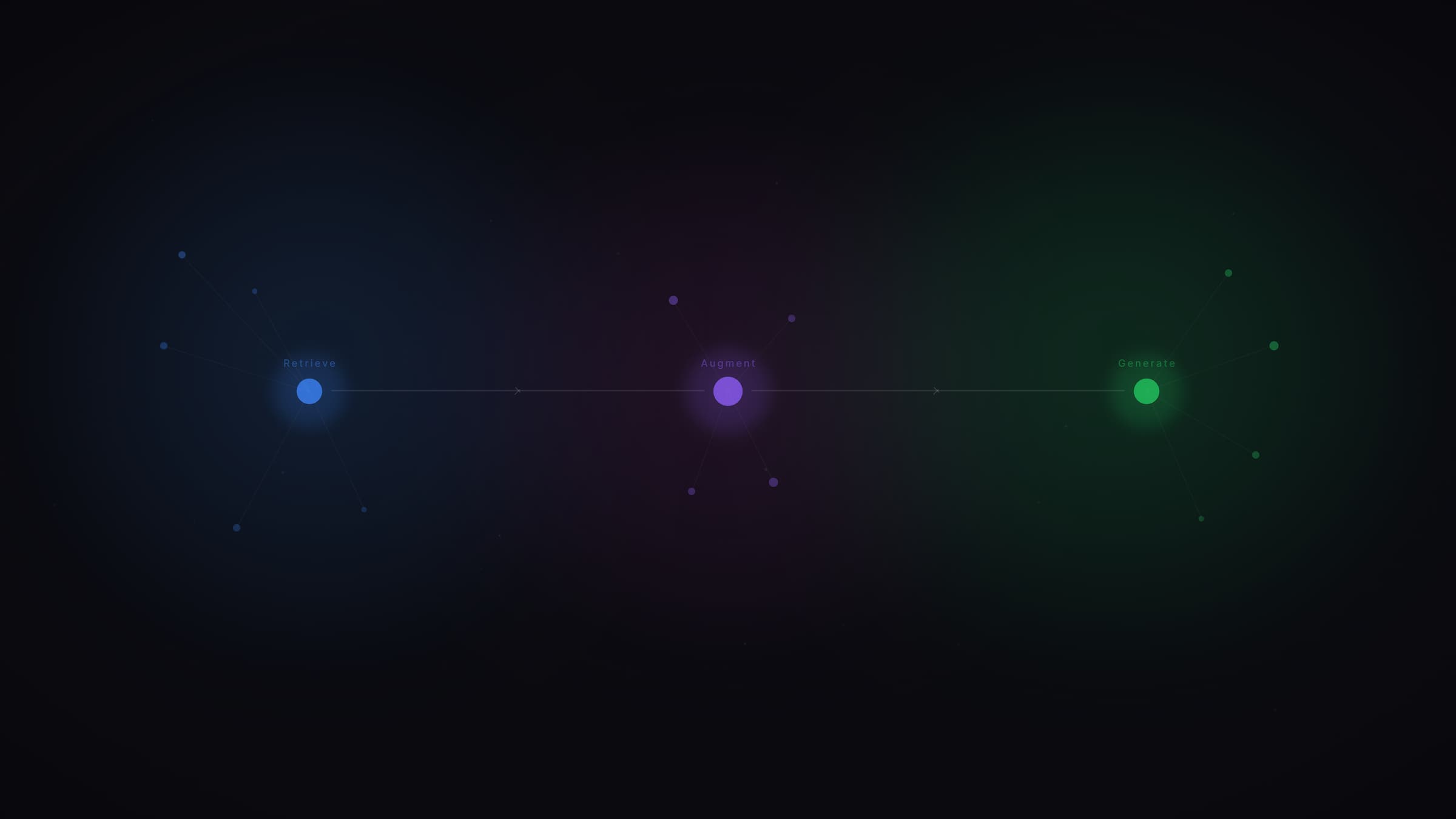

Comment fonctionne le RAG : le pipeline en 5 étapes

Pour comprendre pourquoi certains contenus sont cités par les IA et d'autres non, il faut regarder ce qui se passe concrètement quand un utilisateur pose une question.

1. Réception de la requête

L'utilisateur pose une question à ChatGPT, Perplexity ou Gemini. Le modèle analyse l'intention derrière la requête et détermine s'il a besoin d'informations externes pour répondre. Si oui, le processus RAG se déclenche.

2. Récupération des contenus (Retrieval)

L'IA lance des recherches sur le web ou dans ses index pour trouver des pages pertinentes. Cette étape fonctionne comme un moteur de recherche classique : le système identifie les documents les plus susceptibles de contenir la réponse. C'est à ce stade que le query fan-out intervient, en décomposant la question en plusieurs sous-requêtes pour couvrir tous les angles du sujet.

3. Découpage en chunks

Les pages récupérées ne sont pas traitées en entier. Elles sont découpées en passages (appelés "chunks") de 200 à 800 tokens selon les systèmes. Ce découpage se fait généralement par paragraphe, par section H2, ou par fenêtre glissante. C'est un point fondamental : l'IA ne lit pas votre page du début à la fin. Elle isole des blocs d'information.

4. Vectorisation et classement

Chaque chunk est transformé en une représentation mathématique (un vecteur, ou "embedding") qui capture sa signification. Le système compare ensuite ces vecteurs avec la requête utilisateur par similarité sémantique (similarité cosinus). Les chunks dont le sens est le plus proche de la question sont sélectionnés. En général, seuls les 5 à 20 passages les plus pertinents sont retenus pour la suite.

5. Génération de la réponse

Le LLM reçoit les chunks sélectionnés comme contexte et les utilise pour construire sa réponse. Il reformule, synthétise, et peut ajouter des citations vers les sources. Si les informations sont incomplètes ou contradictoires, le système peut relancer des recherches complémentaires.

En résumé : le RAG est ce qui transforme un modèle de langage en moteur de recherche conversationnel capable de citer ses sources.

Ce que le RAG change pour le SEO et le GEO

Le RAG ne remplace pas le SEO. Il ajoute un nouveau critère de sélection pour votre contenu : la capacité à être extrait, compris et cité par une IA.

Comme l'a expliqué John Mueller de Google, la partie "retrieval" du RAG est fondamentalement ce sur quoi les SEO travaillent depuis toujours : rendre le contenu crawlable, indexable, et accessible. Ce qui change, c'est la suite du processus. Une fois trouvé, votre contenu est découpé, vectorisé, comparé sémantiquement, puis utilisé comme matière première pour construire une réponse. C'est une exigence de précision que le SEO classique n'imposait pas.

La pertinence se joue au niveau du passage, pas de la page

En SEO classique, vous optimisez une page pour un mot-clé. En GEO, ce qui compte c'est la qualité de chaque passage individuel. Un article de 3000 mots peut être invisible pour une IA si aucun de ses paragraphes ne répond directement à une sous-requête. A l'inverse, un paragraphe de 4 phrases bien structuré, clair et factuel peut être extrait et cité seul.

Le système RAG évalue chaque chunk indépendamment. La densité informationnelle de chaque passage est donc plus importante que la longueur globale de la page. Une phrase qui apporte un fait vérifiable vaut plus qu'un paragraphe de contextualisation vague.

La similarité sémantique remplace la correspondance de mots-clés

Les systèmes RAG ne cherchent pas des mots-clés exacts. Ils cherchent des correspondances de sens. Un contenu sur "placements financiers pour débutants" peut être récupéré pour une requête "où investir quand on n'y connait rien", même si les mots utilisés sont différents. Ce qui compte, c'est l'alignement sémantique entre votre contenu et la requête.

Concrètement, cela signifie que la couverture d'un sujet en langage naturel, avec des variantes, des synonymes et des reformulations, a plus de valeur qu'une répétition de la même expression cible.

La fraicheur du contenu est un signal fort

Les systèmes RAG privilégient les contenus récents pour les sujets qui évoluent. Selon les données de Perplexity analysées par Security Boulevard (février 2026), 76,4% des pages fortement citées avaient été mises à jour dans les 30 derniers jours. Afficher clairement la date de publication et de mise à jour, et actualiser régulièrement vos contenus stratégiques, est un levier direct sur votre visibilité IA.

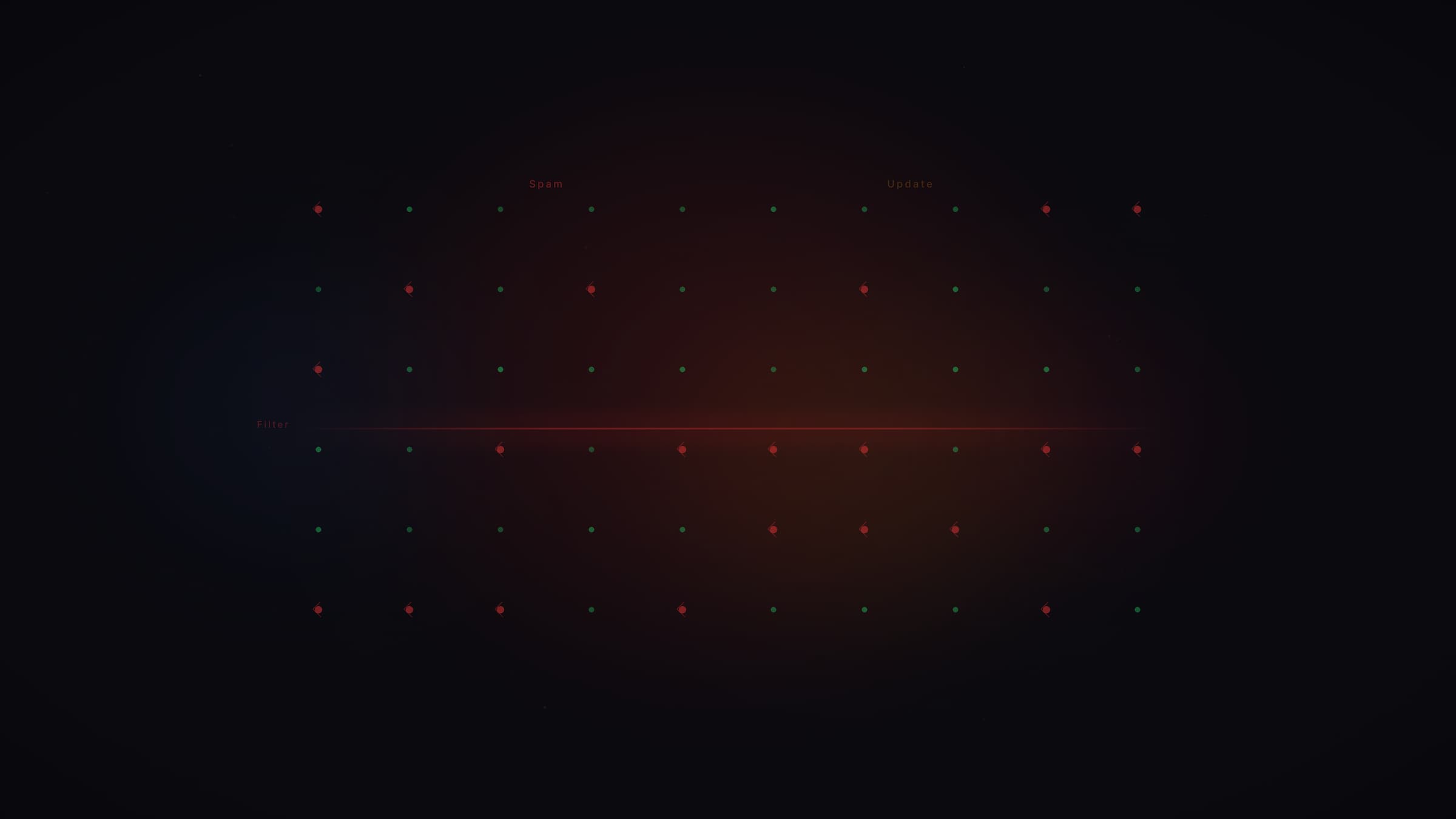

Les erreurs qui rendent un contenu invisible au RAG

Certaines pratiques courantes en rédaction web bloquent mécaniquement le processus de récupération par les systèmes RAG.

Les introductions génériques longues

Le premier chunk d'un document est le plus critique pour le retrieval. Si vos 300 premiers mots sont du contexte vague ("dans un monde en constante évolution..."), le vecteur de ce chunk sera trop éloigné de toute requête précise. L'IA ne le récupérera pas.

Le contenu dilué

Un article qui contient 2 faits vérifiables sur 2000 mots produit des chunks à faible densité informationnelle. Les embeddings de ces passages se retrouvent dans des zones "creuses" de l'espace vectoriel, loin des requêtes utilisateurs. Chaque phrase doit apporter une information nouvelle.

Le contenu purement promotionnel

Les passages qui vendent au lieu de répondre ne sont pas sélectionnés par les systèmes RAG. L'IA cherche des passages qui répondent à des questions, pas des passages qui décrivent les qualités d'un produit ou service. Si vous avez des preuves concrètes (chiffres, cas clients, certifications), incluez-les. Mais le passage doit rester informatif avant tout.

L'absence de structure claire

Un texte sans sous-titres explicites, sans paragraphes courts, sans séparation nette entre les idées, produit des chunks incohérents lors du découpage. Le système RAG ne peut pas isoler une réponse précise dans un bloc de texte indifférencié.

Le contenu en JavaScript pur

Certains bots IA ne rendent pas le JavaScript. Si votre contenu principal est chargé dynamiquement, il peut être totalement invisible pour les systèmes de retrieval. Les informations essentielles doivent être dans le HTML statique.

Pour aller plus loin sur les bonnes pratiques de structuration, consultez notre guide : Comment optimiser son contenu pour être cité par les IA.

RAG et GEO : le lien fondamental

Le RAG est le mécanisme technique. Le GEO (Generative Engine Optimization) est la discipline qui consiste à optimiser votre contenu pour ce mécanisme.

Chaque recommandation GEO trouve son origine dans le fonctionnement du pipeline RAG :

Les clusters thématiques existent pour couvrir l'ensemble des sous-requêtes générées par le query fan-out lors de la phase de retrieval.

Les données structurées Schema.org (FAQPage, DefinedTerm, etc.) existent pour faciliter le parsing et le chunking par les systèmes IA. Un contenu correctement balisé est plus facilement extractible. On détaille les schemas prioritaires dans notre guide : Données structurées : indispensables pour le SEO et le GEO.

Les paragraphes courts avec réponse directe en première phrase existent pour maximiser la qualité des embeddings de chaque chunk. Plus un passage est clair et autonome, meilleur est son vecteur.

La réputation externe (presse, forums, plateformes d'avis) existe parce que les systèmes RAG appliquent des filtres d'autorité sur les sources récupérées. Un domaine régulièrement mentionné dans des sources fiables obtient une préférence lors de la sélection.

En d'autres termes : comprendre le RAG, c'est comprendre pourquoi chaque action GEO fonctionne.

Exemple concret : comment une fintech se fait citer (ou pas)

Prenons un utilisateur qui demande à ChatGPT : "Quelle est la meilleure plateforme de gestion pilotée en 2026 ?"

Le système RAG va :

- Lancer plusieurs recherches (fan-out) : comparatifs gestion pilotée, avis utilisateurs, performances 2025-2026, frais de gestion, etc.

- Récupérer les pages les plus pertinentes sur ces sous-requêtes

- Découper ces pages en chunks et les vectoriser

- Sélectionner les 10-15 passages les plus proches sémantiquement de la question

- Générer une réponse en citant les sources

Un site qui sera cité : une page comparatif avec un tableau clair (nom, frais, performance, note), des données chiffrées récentes, un schema Product ou FinancialProduct, une FAQ structurée, et une date de mise à jour visible. Chaque section est autonome et répond à une facette de la question.

Un site qui ne sera pas cité : une page qui parle de "gestion pilotée" de manière générale sans données comparatives, avec une longue introduction sur "l'importance de bien gérer son patrimoine", sans dates, sans chiffres, sans structure extractible.

La différence n'est pas la qualité rédactionnelle. C'est la compatibilité avec le pipeline RAG.

Notre point de vue chez Vydera

Le RAG est le fondement technique de tout ce que nous faisons en GEO. Dans nos audits de visibilité, la première chose que nous vérifions, c'est si le contenu du client est structuré pour être récupéré et extrait par les systèmes RAG.

Ce qu'on observe dans la pratique : la plupart des sites ne sont pas invisibles parce que leur contenu est mauvais. Ils sont invisibles parce que leurs passages ne sont pas autonomes, leurs introductions sont trop longues, et leurs données factuelles sont enfouies dans du texte promotionnel. Ce sont des problèmes de structure, pas de qualité.

L'autre constat récurrent : les entreprises qui investissent dans les données structurées et la réputation externe obtiennent des résultats mesurables plus rapidement. Ce ne sont pas les leviers les plus visibles, mais ce sont ceux que le pipeline RAG valorise le plus directement.

Le SEO reste la fondation. Le RAG est la couche qui détermine si cette fondation est exploitable par les IA. Les deux fonctionnent ensemble. Pour comprendre les différences et les complémentarités : SEO vs GEO : ce qui change vraiment.

Quelle est la différence entre RAG et LLM ?

Un LLM (Large Language Model) est le modèle de langage lui-même. Le RAG est le processus qui lui permet d'accéder à des informations externes en temps réel. Sans RAG, un LLM ne peut utiliser que ce qu'il a appris pendant son entrainement. Avec le RAG, il peut aller chercher des contenus actualisés sur le web, les analyser, et les citer dans sa réponse.

Le RAG est-il utilisé par toutes les IA génératives ?

Oui. ChatGPT, Gemini, Perplexity et Google AI Overviews utilisent tous une forme de RAG pour leurs réponses connectées au web. Les détails d'implémentation varient (sources interrogées, nombre de chunks retenus, méthodes de re-ranking), mais le principe reste le même : récupérer, découper, vectoriser, sélectionner, générer.

En quoi le RAG est-il différent d'un moteur de recherche classique ?

Un moteur de recherche classique vous donne une liste de liens. Le RAG va plus loin : il lit les pages, en extrait les passages pertinents, et les utilise pour construire une réponse synthétique. Votre contenu n'est plus une destination finale. Il devient une brique d'information que l'IA assemble avec d'autres sources pour produire sa réponse.

Est-ce que le RAG va remplacer le SEO ?

Non. Le RAG dépend du SEO pour fonctionner. La phase de retrieval du RAG utilise les index des moteurs de recherche (Google, Bing) pour trouver les pages pertinentes. Si votre contenu n'est pas indexé et bien positionné en SEO, il ne sera pas récupéré par le RAG. Les deux disciplines sont complémentaires.

Comment savoir si mon contenu est "RAG-compatible" ?

Testez vos requêtes stratégiques dans ChatGPT, Perplexity et Gemini. Si votre site n'est jamais cité, c'est que vos contenus ne passent pas les filtres du pipeline RAG (densité informationnelle insuffisante, structure non extractible, manque de signaux d'autorité). Notre guide sur les outils GEO détaille les solutions pour automatiser ce suivi.

.jpg)

.jpg)