Définition d'un LLM

Un LLM (Large Language Model) est un modèle d'intelligence artificielle entraîné sur des milliards de paramètres à partir de quantités massives de texte. Il est capable de comprendre le langage naturel, générer du texte, répondre à des questions et exécuter des tâches complexes comme la synthèse de documents, la traduction ou la génération de code.

Les LLMs fonctionnent sur une architecture Transformer, introduite par Google en 2017. Cette architecture leur permet d'évaluer l'importance relative de chaque mot dans une phrase, créant une compréhension contextuelle que les modèles précédents ne possédaient pas.

Les principaux LLMs en 2026 :

- GPT-4o / GPT-5 (OpenAI) : moteur de ChatGPT

- Gemini 2.5 (Google) : intégré dans Google Search et AI Overviews

- Claude (Anthropic) : orienté sécurité et raisonnement long

- Llama 4 (Meta) : open-source, jusqu'à 10 millions de tokens de contexte

- Mistral (Mistral AI) : compétitif en performance/coût

Ce qui change pour les LLMs en 2026

L'écosystème LLM a profondément évolué. Le marché mondial est estimé à plus de 10 milliards de dollars, et 67 % des organisations ont déjà adopté des LLMs dans leurs opérations.

Trois tendances structurantes :

- Capacités agentiques : les LLMs ne se contentent plus de générer du texte. Ils planifient et exécutent des tâches en autonomie, interagissent avec des outils et des API via des protocoles comme MCP

- Fenêtres de contexte étendues : Llama 4 Scout atteint 10 millions de tokens. Cette évolution réduit la dépendance au RAG classique pour les requêtes documentaires

- Multimodalité : les modèles traitent désormais texte, images, audio et vidéo simultanément

L'écart entre modèles open-source et propriétaires se réduit. Il était d'environ un an en 2024, il est tombé à six mois en 2025. Les modèles open-weight sont de plus en plus viables pour des déploiements souverains et privés.

Pourquoi les LLMs sont au cœur du GEO

Pour toute stratégie de visibilité IA, comprendre les LLMs n'est pas optionnel. Ce sont eux qui décident quelles sources citer dans leurs réponses. Et chaque LLM a ses propres préférences.

Ce qu'on constate chez Vydera : les algorithmes de citation varient considérablement d'un LLM à l'autre. ChatGPT s'appuie fortement sur Bing et ses données d'entraînement. Perplexity privilégie les sources fraîches et bien structurées. Claude accorde moins de poids à la recherche web et plus à sa base de connaissances. Google AI Overviews puise dans son propre index.

Optimiser pour un seul LLM ne suffit pas. Une stratégie GEO efficace prend en compte les spécificités de chaque modèle.

Comment les LLMs sélectionnent leurs sources

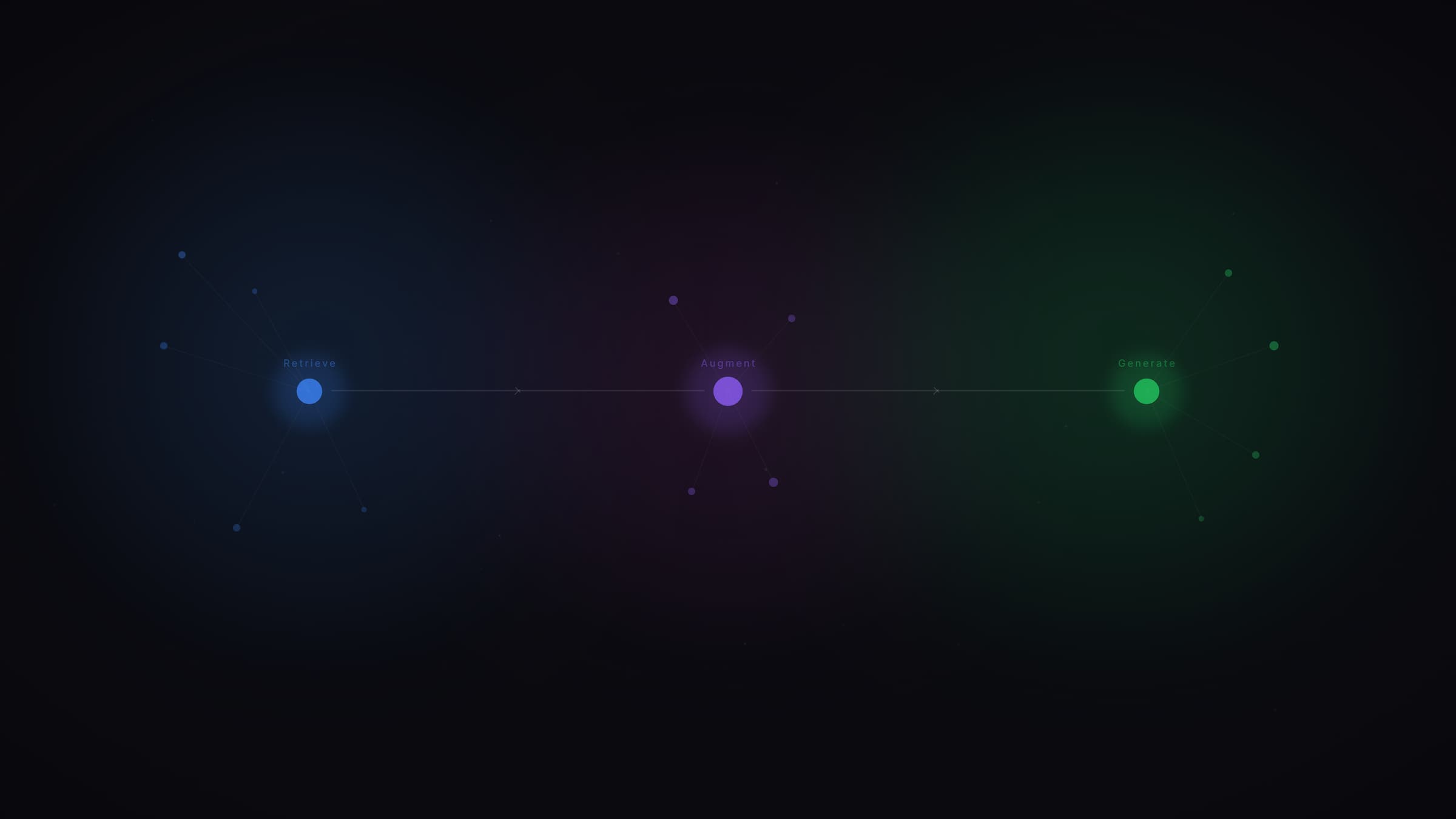

Les LLMs qui intègrent de la recherche web (ChatGPT Search, Perplexity, AI Overviews) utilisent un pipeline en plusieurs étapes :

1. Décomposition de la requête. Le modèle reformule la question en sous-requêtes parallèles (query fan-out).

2. Récupération des sources. Un système RAG récupère les contenus les plus pertinents depuis un index web ou une base vectorielle.

3. Sélection et synthèse. Le LLM évalue la pertinence, la crédibilité et la fraîcheur des sources, puis synthétise sa réponse en citant celles qu'il juge les plus fiables.

Votre contenu doit survivre à chacune de ces étapes pour être cité.

Sources et références

- Sebastian Raschka, The State of LLMs 2025: Progress and Predictions

- Aggarwal et al., GEO: Generative Engine Optimization, ACM SIGKDD 2024

- Hostinger, LLM Statistics 2026: Adoption, Trends, and Market Insights

Aller plus loin

Comprendre les LLMs, c'est comprendre les règles du jeu de la visibilité IA. Chez Vydera, on analyse le comportement de citation de chaque modèle pour adapter la stratégie de contenu de nos clients. Découvrez nos études de cas ou explorez le Lab Vydera.

Quelle est la différence entre un LLM et une IA générative ?

Un LLM est un type d'IA générative spécialisé dans le langage. L'IA générative est un terme plus large qui inclut aussi la génération d'images (Midjourney, DALL-E), de vidéos, de musique et de code. Les LLMs sont les modèles qui alimentent les chatbots et les moteurs de réponse IA.

Les LLMs vont-ils remplacer Google ?

Pas remplacer, mais transformer profondément les comportements de recherche. Gartner prévoit une baisse de 25 % du volume de recherche traditionnelle d'ici 2026. Google intègre lui-même des LLMs via les AI Overviews. La recherche ne disparaît pas, elle se redistribue entre plusieurs plateformes.

Tous les LLMs citent-ils les mêmes sources ?

Non, et c'est un point critique pour le GEO. Chaque LLM a ses propres mécanismes de sélection. ChatGPT s'appuie sur Bing, Perplexity sur sa propre recherche web, Claude sur sa base de connaissances, Gemini sur l'index Google. Le chevauchement entre les citations IA et le top 10 Google n'est que de 12 % selon Ahrefs.

Qu'est-ce qu'un modèle open-source vs propriétaire ?

Un modèle propriétaire (GPT, Gemini, Claude) garde ses données d'entraînement et paramètres confidentiels. Un modèle open-weight (Llama, Mistral) publie ses poids, permettant un déploiement local et un contrôle total des données. L'écart de performance entre les deux se réduit rapidement et devrait se combler en 2026.

.jpg)