Définition du query fan-out

Le query fan-out est le processus par lequel un moteur IA décompose une question complexe en plusieurs sous-requêtes parallèles pour construire une réponse plus complète et plus fiable. Quand vous tapez "meilleur outil de gestion de projet pour une équipe distante", le modèle ne cherche pas cette phrase telle quelle. Il génère silencieusement des variantes : "comparatif outils gestion projet", "gestion équipe télétravail logiciel", "Asana vs Trello équipe remote". Ce sont ces sous-requêtes qui déterminent quelles sources seront citées dans la réponse finale. Votre contenu est évalué passage par passage, pas page par page.

Le query fan-out en 2026 : chaque question génère entre 8 et 15 sous-requêtes

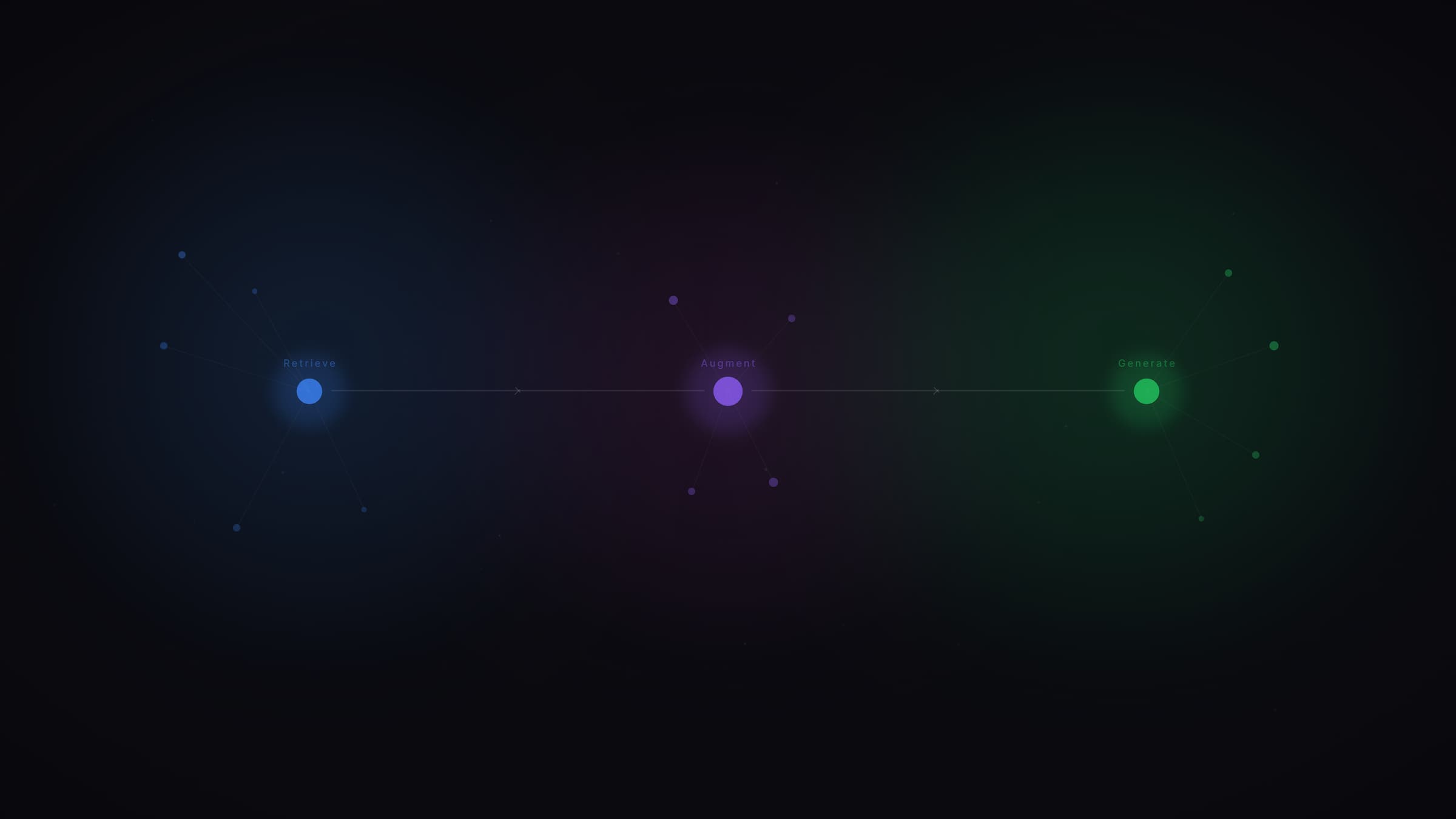

Des données récentes analysant plus de 72 000 requêtes générées par IA montrent qu'une question posée à ChatGPT ou Gemini déclenche en moyenne 8 à 10 sous-requêtes parallèles. 95 % de ces sous-requêtes ont un volume de recherche nul dans les outils SEO classiques : elles n'apparaissent jamais dans vos rapports, mais ce sont elles qui gouvernent votre visibilité générative. Google a formalisé ce mécanisme dans deux brevets majeurs : le brevet US20240289407A1 ("Search with Stateful Chat", août 2024) et le brevet PROMPTAGATOR WO2024064249A1 (mars 2024), qui décrit un système générant entre 7 et 9 types de requêtes synthétiques à partir d'une seule question. Le query fan-out est au cœur de l'architecture RAG (Retrieval-Augmented Generation) : il renforce la phase de récupération en multipliant les angles d'extraction pour réduire les hallucinations et ancrer les réponses sur des sources vérifiables.

Ce qu'on observe chez Vydera sur les contenus ignorés par les IA

Les contenus monolithiques, une seule page longue sur un sujet, sont systématiquement sous-performants dans les citations IA. Non pas parce qu'ils sont de mauvaise qualité, mais parce qu'ils ne couvrent qu'un angle de la question. Un article qui explique "ce qu'est un LMS" sera sélectionné sur la sous-requête définition, mais ignoré sur les sous-requêtes "comparatif LMS PME", "LMS conformité RGPD" ou "coût déploiement LMS 500 collaborateurs". Ce constat change radicalement la logique de production de contenu. Ce n'est plus un article = une requête. C'est un cluster de contenu = une question avec toutes ses dimensions implicites. Les marques qui gagnent en visibilité IA sont celles qui couvrent l'ensemble des angles qu'un modèle considère pertinents pour répondre à une intention donnée.

Structurer son contenu pour couvrir les sous-requêtes

La méthode la plus fiable est de partir de la question cible et de cartographier ses sous-requêtes avant de produire le contenu. En pratique :

- Utilisez l'onglet "Steps" ou "Sources" de Perplexity ou Gemini sur votre requête cible pour voir les sous-requêtes que le modèle génère réellement.

- Croisez avec les "People Also Ask" de Google et les données de votre Search Console.

- Structurez chaque section de votre contenu pour répondre à une sous-requête spécifique, avec un H2 qui formule la question et une réponse directe dans les 60 premiers mots.

- Le format FAQ avec données structurées FAQPage est particulièrement efficace : il correspond nativement au format que les LLMs exploitent lors du fan-out.

Un contenu bien couvert au niveau des sous-requêtes multiplie vos chances d'être sélectionné lors du processus de fan-out, indépendamment de votre position SEO sur la requête principale.

Sources et références

- Query fan-out : le mécanisme LLM qui remodèle le SEO et le GEO, Vydera Lab

- How AI Query Fan-Out is Reshaping SEO in 2026, 85SIXTY (analyse 72 000+ requêtes)

- Brevet PROMPTAGATOR WO2024064249A1, Google (mars 2024)

Aller plus loin

Le query fan-out change la façon dont vous devez penser votre stratégie de contenu. Sur le Vydera Lab, on publie régulièrement des analyses sur l'optimisation pour les moteurs génératifs. Et si vous voulez savoir comment vos contenus actuels répondent aux sous-requêtes de vos requêtes cibles, parlons-en sur notre page contact.

Comment le query fan-out impacte-t-il la visibilité d'un site dans les IA ?

Le query fan-out détermine quelles sources sont extraites pour chaque sous-requête. Si votre contenu répond à l'angle principal mais pas aux angles secondaires implicites, vous serez cité de façon partielle ou pas du tout. La visibilité dans les réponses IA dépend de la couverture thématique de vos contenus, pas uniquement de votre position SEO sur la requête principale.

Tous les LLMs utilisent-ils le query fan-out de la même manière ?

Non. Il y a des différences notables entre les plateformes. Google Gemini orchestre les sous-requêtes sur plusieurs sources (index web, Knowledge Graph, Google Shopping). ChatGPT avec recherche activée génère des sous-requêtes visibles dans le code JavaScript lors de la génération. Perplexity affiche ses sous-requêtes dans l'onglet "Steps". La logique est la même, mais les patterns de fan-out varient selon les modèles et les données d'entraînement.

Comment structurer son contenu pour couvrir les sous-requêtes du query fan-out ?

La méthode la plus efficace consiste à partir de la question cible, à identifier ses sous-requêtes via Perplexity ou Gemini (onglet Sources ou Steps), puis à structurer chaque section H2 pour répondre à une sous-requête spécifique, avec la réponse directe dans les 60 premiers mots. Le format FAQ avec schema FAQPage correspond nativement au format exploité par les LLMs lors du fan-out. Un corpus multi-pages couvrant tous les angles d'un sujet est plus efficace qu'un seul article exhaustif.

Le query fan-out fonctionne-t-il différemment selon le type de requête ?

Oui. Les requêtes simples et factuelles peuvent ne pas déclencher de fan-out : le modèle répond depuis ses données d'entraînement. Ce sont les requêtes complexes, comparatives ou sensibles à l'actualité qui déclenchent le plus de sous-requêtes. Les requêtes de type "meilleur X pour Y" ou "comment faire X dans le contexte Y" génèrent systématiquement 8 à 15 sous-requêtes parallèles. Plus la requête implique de nuances, plus le fan-out est étendu.